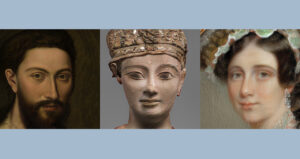

این شرکت آخرین مدل هوش مصنوعی خود را که با استفاده از یک مجموعه داده کوچک از آثار هنری موزه هنر متروپولیتن، که فقط کسری از اندازهی از دادههایی است که معمولاً برای یک شبکه مولد تخاصمی ((Generative Adversarial Network (GAN) استفاده میشود، به نمایش گذاشت.

با استفاده از این مجموعه دادهها، مدل هوش مصنوعی شرکت NVIDIA توانست تصاویر جدیدی ایجاد کند که همسبک با کارهای هنرمندان اصلی است. این مدل همچنین توانست از تصاویر ذکر شده برای کمک به آموزش بیشتر مدلهای هوش مصنوعی استفاده کند. این مدل هوش مصنوعی با استفاده از تکنیک دستیابی به موفقیت در شبکه عصبی، مانند مدل محبوب NVIDIA StyleGAN2، به این موفقیت چشمگیر دست یافت.

این تکنیک Adaptive Discriminator Augmentation یا ADA نامیده میشود و NVIDIA ادعا میکند که تعداد تصاویر آموزشی مورد نیاز را تا 10 الی 20 برابر کاهش میدهد، در حالی که همچنان خروجی افت نمیکند و همچنان نتایج خوبی دارد. David Luebke، معاون تحقیقات گرافیک در NVIDIA، گفت:

“این نتایج به این معنی است كه افراد میتوانند از GAN برای حل مشكلاتی استفاده كنند كه حجم مقادیر داده زیاد بوده و تجزیه اطلاعات آن وقتگیر باشد و یا دستیابی به حجم بالایی از دادهها دشوار باشد.” وی افزود: “نمیتوانم صبر کنم ببینم هنرمندان، متخصصان پزشکی و محققان از این تکنولوژی در چه مواردی استفاده میکنند.”

به عنوان مثال بهداشت و درمان یک زمینه خاص و هیجان انگیز است که در آن میتوان تحقیقات NVIDIA را اعمال کرد. این تکنولوژی میتواند در ایجاد تصاویر بافتشناسی سرطان برای آموزش سایر مدلهای هوش مصنوعی مفید باشد. دستیابی به این موفقیت به مشکلات پیرامون بیشتر مجموعه دادههای موجود کمک شایانی خواهد کرد.

در اغلب موارد برای آموزش هوش مصنوعی به حجم دادههای زیادی نیاز است اما همیشه این منابع در دسترس نیستند. از طرف دیگر، اطمینان یافتن از مناسب بودن محتوای مجموعههای بزرگتر نیز امری دشوار است و ممکن است ناخواسته منجر به سوگیری الگوریتمی شود.

در اوایل سال جاری، MIT مجبور شد مجموعه بزرگی از داده به اندازه 80 میلیون تصویر کوچک که برای آموزش هوش مصنوعی مورد استفاده قرار میگرفت را حذف کند. این مقدار از داده برای آموزش هوش مصنوعی کاملا مناسب است اما مشخص شد که دادههای مذکور حاوی تصاویری با برچسب نژادپرستانه، زن ستیزانه و سایر اصطلاحات غیرقابل قبول است.

MIT در بیانیهای که در وبسایت خود منتشر کرده بود ادعا کرد که از این برچسبهای توهینآمیز بیاطلاع بوده و این مشکلات نتیجه روش جمعآوری خودکار دادهها است که به WordNet متکی بودند.

این بیانیه در ادامه توضیح میدهد که 80 میلیون تصویر موجود در این مجموعه با اندازهی 32 × 32 پیکسل بوده و این بدان معناست که بازرسی دستی تقریباً غیرممکن بوده و نمیتوان تضمین کرد که تمام تصاویر توهینآمیز حذف شوند. حالا اما یک مجموعه داده کوچک که میتوان به صورت دستی نیز آن را مورد بررسی قرار داد، میتواند برای آموزش مدلهای هوش مصنوعی کافی باشد و میتوان از تکنیکی مانند NVIDIA’s ADA برای ایجاد تصاویر جدید استفاده کرد که از نسخههای اصلی پیروی میکنند.

NVIDIA در یک پست در وبلاگ خود نوشت:

“برای آموزش GAN با کیفیت بالا معمولاً به مجموعه دادهای شامل 50000 تا 100000 تصویر آموزشی نیاز است. اما در بسیاری از موارد محققان به این حجم از داده دسترسی ندارند. با داشتن دو هزار تصویر برای آموزش، اکثر GANها در تولید نتایج واقعی دچار مشکل میشوند اما این مشکل با تکنولوژی جدید شرکت nvidia تا حد زیادی هموار خواهد شد. “