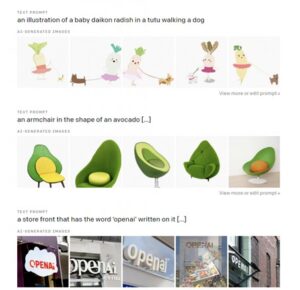

OpenAI آخرین نوآوری شگفتانگیز خود که یک شبکه عصبی تصویرساز به نام DALL • E است را ارائه داده است. DALL • E یک نسخه 12 میلیارد پارامتری از GPT-3 است که برای تولید تصاویر از روی متنهای توصیفی، آموزش دیدهاست.

OpenAI میگوید:”ما فهمیدیم كه DALL • E قادر است برای انواع مختلفی از جملات كه ساختار تركیبی زبان را کاوش میكنند، تصاویر قابل قبولی ایجاد كند.” تصاویر ایجاد شده میتوانند نقاشی، اشیا و حتی عکسهای دستکاری شده دنیای واقعی باشند. در زیر چند نمونه از مثالهای ارائهشده توسط OpenAI آورده شدهاست:

هشدارهای زیادی درمورد استفاده از تولیدکننده متن OpenAI GPT-3 برای ایجاد اخبار جعلی درمورد کرونا ویروس، 5G و همچنین تلاش برای تأثیرگذاری بر روندهای مختلف دموکراتیک، داده شدهاست و نگرانیهای مشابهی در مورد این فناوری جدید نیز وجود دارد.

امروزه مردم به طور فزایندهای در محاصره اخبار جعلی هستند و این مسئله باعث شده تا هر آنچه را که خصوصاً از منابع ناشناخته و بدسابقه میخوانند، باور نمیکنند. با این حال، ما به عنوان انسان هنوز عادت داریم آنچه را که با چشم میببینیم، باور کنیم. برای ما اخبار جعلی با تصاویر پشتیبان جعلی یک ترکیب کاملاً قانع کننده است.

تقریباً همانطور که به GPT-3 انتقاداتی وارد شدهاست، طبق نظر OpenAI با به کار بردن هرچه بیشتر این فناوری مسئولیتپذیری افزایش مییابد و درنتیجه آگاهی افزایش مییابد و تحقیقاتی در زمینه چگونگی مقابله با پیامدهای قبل از ایجاد این شبکههای عصبی و استفاده ناگهانی از آنها، که توسط احزاب مخرب ایجاد میشوند انجام میشود.

OpenAI میگوید: “ما متوجه شدهایم كه كارهایی كه شامل مدلهای مولد هستند میتوانند تأثیرات چشمگیر و گسترده اجتماعی داشته باشند. ما در نظر داریم در آینده چگونگی ارتباط مدلهایی مانند DALL • E با موضوعات اجتماعی نظیر تأثیر اقتصادی بر برخی از فرآیندهای مشاغل، پتانسیل بایاس شدن در خروجی مدل و چالشهای اخلاقی بلند مدتتری که این فناوری نشان میدهد، را تجزیه و تحلیل کنیم. ”

پیشرفتهای تکنولوژی گاهی برای اهداف مخرب نیز مورد استفاده قرار میگیرند. اما اغلب مزایای این پیشرفتها بیشتر از خطرات آنها است. قطعا شما میتوانید مدت طولانی در مورد جنبههای خوب و بد اینترنت صحبت کنید، اما اینترنت در کل یک فناوری خارقالعاده است. در نهایت اگر “آدم های خوب” چیزی را نسازند، قطعا انسانهای بد این کار را خواهند کرد.